Onlangs won Delft Robotics de Amazon Picking Challenge. De wedstrijd, die door Amerika’s grootste webwinkel was georganiseerd, toont volgens Dr. Ir. Martijn Wisse twee dingen aan. Binpicking is nog steeds moeilijk. Maar Delft behoort tot de wereld top en ligt goed op koers voor een snel te integreren, robuuste industriële praktijk.

“We vinden de mens erg interessant en bestuderen hem sinds mensenheugenis”, zegt Dr. Ir Martijn Wisse tijdens een persmomentje met demonstratie na de overwinning. De eerste hoogleraar Biorobotica van Nederland kan het weten. Hij bestudeert met name de biologie van de mens welke als voorbeeld kan dienen hoe je een robot het beste kunt ontwerpen. Een vorm van biomimicry dus, die sinds 2015 ook een plek heeft binnen de faculteit Werktuigbouwkunde, Maritieme Techniek en Technische Materiaalwetenschappen (3mE), van de TU Delft.

De theorie

“Het bestuderen van de biologie van de mens is fascinerend. En toen we de hand nader bekeken in een zoektocht naar een zeer veelzijdig en gevoelig grijpinstrument, besloten we dat er meer mee moest en kon. Het resulteerde in de oprichting van Lacquey, dat nu succesvol flexibele grijpers ontwikkelt voor zeer uiteenlopende toepassingen. Maar zonder slag of stoot ging dit niet. Het probleem bleek niet zo zeer het ontwikkelen van een grijper, maar de integratie ervan. Hoe zorg ik dat een robot hem precies zo gebruikt zoals de bedoeling is? Dat oplossen kon je zomaar een jaar of meer kosten. Dat is natuurlijk veel te lang en maakte het te duur.”

De pilot

Volgens Wisse zocht de TU Delft hierop de samenwerking in Europa om het op te lossen. De universiteit van München, Frauenhofer en de KU Leuven zetten hun schouders onder een nieuw project: Factory-in-a-day. Hun doel? Zeer snelle en laagdrempelige robotisering door een maatwerkgrijper te printen, zelfkalibrerende robots met de vrachtwagen binnen te rijden en ze binnen een dag leren wat ze moeten doen. “De eerste pilot was bij een kweker met potplanten”, herinnert Wisse zich. “OK: een dag was wat kort. Maar in twee dagen draaide er een prototype.”

Het succes van de pilot smaakte naar meer. Maar binnen het Factory-in-a-day project bleek dat wat lastig te realiseren. “We hadden een prototype gebouwd, maar geen industrieel product. Die stap zou veel langer duren. Ondertussen stroomden de aanvragen binnen. Een robot binnen twee dagen aan de praat? Daar had men wel oren naar. We besloten daarop Delft Robotics op te richten. Geen onderzoeksinstelling, maar een bedrijf dat buiten het Factory-in-a-day programma projecten kon aannemen en het MKB verder kon helpen.” De termijn van een dag bleef echter buiten bereik. Een paar maanden. Dat kon wel. Waarom bleef het zo lastig? Deed men in Delft wat fout?

De kans

En toen riep Amazon een wedstrijd uit: de picking challenge. Voor Wisse was het meer dan alleen een eureka momentje. “Lukt het een bedrijf als Amazon ook niet goed om een fatsoenlijke binpicking-oplossing te bouwen? En dat terwijl hun magazijnen beroemde geoliede machines boordevol robots zijn? Dan is een paar maanden misschien helemaal zo gek nog niet.” Dit vermoeden werd gesterkt door het feit dat ook de Europese collega’s binnen het Factory-in-a-day project de ‘dag’ nog lang niet in het vizier hadden. Misschien maakten ze zelfs wel een kans de challenge te winnen? Binnen de Delftse gelederen werd overlegd en besloten. Delft Robotics zou zich inschrijven. Het uitgangspunt geen ‘typisch prototype’, maar een robuuste picking-oplossing gebouwd uit ‘industrial grade’ componenten, moest de uitdaging aangaan.

De uitdagingen

Pak met een robot zo snel mogelijk verschillende producten uit een kast en leg ze in een krat. Een order, die tijdens de challenge als file wordt ingelezen, kan uit 40 verschillende producten bestaan variërend van boeken, T-shirts, blikjes, teddyberen of tandenborstels. Waar en hoe een product in de kast staat? Dat is niet vooraf bekend. Pak vervolgens verschillende producten uit het krat en leg ze in het schap in de kast. Feitelijk waren het de werkzaamheden van de zogenoemde pickers die voor de uitdaging model stonden. De echte uitdaging waren volgens Kanter van Deurzen, de projectmanager vanuit Delft Robotics er eigenlijk drie. “Op de eerste plaats is er de beeldherkenning. Hoe weten we waar we mee te maken hebben als we er naar kijken? We maken hiervoor gebruik van deep learning, wat inhoudt dat we het systeem heel veel afbeeldingen vanuit heel veel verschillende hoeken laten zien en middels uitknippen aangeven wat wel en wat niet tot het product behoort. Indien er genoeg beelden voorhanden zijn, kan de computer de gegevens correleren en bepalen waar het naar kijkt. Een tweede uitdaging was het plannen van de beweging. Hoe staat het op te pakken object in de kast en waar pak ik hem. Wat voor beperkingen in bewegingsvrijheid kom ik tegen als ik met mijn grijper de kast in en weer uit ga? En de derde uitdaging: hoe realiseer ik slim overkoepelend gedrag? Kan ik bijvoorbeeld zien of een product achter een ander product staat? En hoe en waar zet ik eerst iets weg om bij het bewuste product te komen. Maar ook kan het voorkomen dat er iets fout gaat. Hoe voorkom ik dan dat de boel niet vastloopt? Kan ik nog een keer opnieuw kijken, een sequentie opnieuw opstarten, of ergens anders verder gaan?”

De winnaar

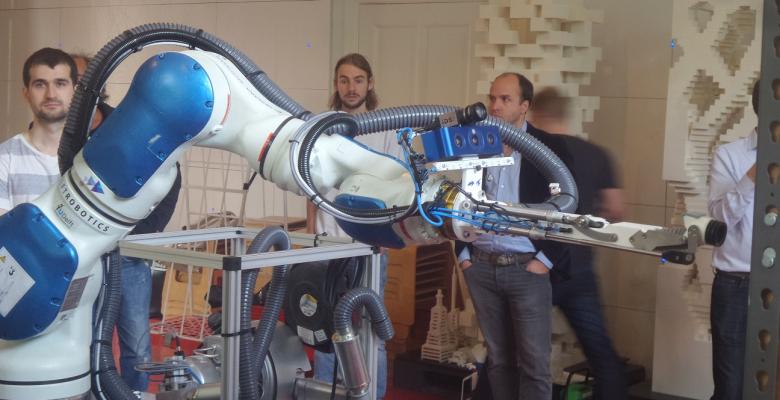

Hoewel ook andere teams 2D-vision met deep learning en 3D-vision voor padplanning gebruikten, bleek Delft Robotics superieur in deze combinatie. Hetzelfde gold voor de bovenliggende ‘common sense’. Deels was dit te danken aan hun ervaring met robuuste industrial grade componenten en methoden. “We hebben vanaf het begin af aan niet beknibbeld op de specificaties. Zo hebben we een industriële Yaskawa robot met 7 graden van vrijheid gebruikt en die ook nog eens op een lineaire slede gezet zodat we al die vrijheden ook achter in de kast ter beschikking hebben voor het slim manoeuvreren van de grijper. Ook deze grijper is robuust, waarbij we voor de meeste producten een zuignap met hoogvolume vacuüm gebruiken. Dit zuigt niet te hard en heeft als voordeel dat je er ook een T-shirt mee kan oppakken. Ook is de grijper voorzien van een uitschuifmechanisme, zodat we er tevens mee kunnen pinchen, zonder dat de grijper groter wordt.” Voor wat betreft het visiondeel heeft Delft Robotics zowel een 2D RGB camera als een 3D Ensenso toegepast. De RGB-camera zorgt voor de beeldherkenning, terwijl met de Ensenso de robot wordt aangestuurd. “Hoewel niet alles goed ging - op ‘het moment suprême’ viel het blikje en dacht de robot dat hij dan wel achter de tandenborstel zou staan – wisten we de opdracht in de helft van de beschikbare tijd uit te voeren. En omdat we industriële componenten hebben toegepast, kan de snelheid na optimalisatie nog wel met een factor 3 tot 4 omhoog.”

Deep learning

Deep learning is hot. Maar in visionland zijn neurale netwerken toch gemeengoed? Wat verstaat Delft Robotics er precies onder? “Hoewel het niet ondenkbaar is dat over een paar jaar zowel de ‘wat ben ik’ als de ‘hoe lig ik en hoe pak ik het op’ informatie onderdeel uitmaakt van het neurale netwerk, hebben we deep learning nu nog alleen op de 2D rgb data toegepast”, licht visionexpert bij Delft Robotics Hans Gaiser toe. “Hiervoor hebben we gebruik gemaakt van bestaande software en algoritmes. VGG 16 voor de classificatie - dus is iets a of b, Faster rcnn voor het bepalen welke regio’s interessant zijn en Caffe als framework waarbinnen alles op onze GPU wordt gebruikt.